英伟达正通过重磅布局服务器CPU领域,进一步巩固其在AI基础设施市场的统治地位。公司CEO黄仁勋确认将推出代号为“Vera”的全新CPU,并首次将其作为独立产品推向市场,旨在消除AI供应链中的算力瓶颈,全面支持代理人工智能(Agentic AI)的发展。

1月26日,据彭博报道,英伟达已承诺向新兴云服务商CoreWeave追加20亿美元投资,CoreWeave将成为首家部署Vera CPU作为独立基础设施选项的客户。黄仁勋在接受彭博Ed Ludlow采访时表示,Vera是一款“革命性”的CPU。分析称,此次合作不仅延续了双方的长期关系,更标志着英伟达在计算堆栈层面的重大战略转折。

报道称,英伟达此举意在解决服务器CPU已成为AI供应链主要瓶颈的问题。通过提供独立的Vera CPU,英伟达为客户提供了更具成本效益的高端计算替代方案,使其不仅能在英伟达GPU上运行计算堆栈,也能在英伟达CPU上处理工作负载,这将对现有的服务器处理器市场格局产生直接影响。

据报道,随着Vera CPU技术细节的曝光以及生产计划的推进,英伟达正展示其在“后Blackwell时代”的雄心。这一战略不仅针对高端机架级解决方案,也开始向更广泛的通用计算市场渗透,试图构建一个全栈式的计算生态系统。

深化CoreWeave合作,首推独立CPU产品

据报道,在此次战略布局中,CoreWeave扮演了关键角色。作为英伟达的重要合作伙伴,CoreWeave正雄心勃勃地计划在2030年前建设5吉瓦(GW)的AI工厂。

根据官方披露,英伟达将以每股87.20美元的价格购买CoreWeave的A类普通股,这笔高达20亿美元的额外投资将直接支持CoreWeave的基础设施扩张。

黄仁勋透露,CoreWeave将不得不“竞速”以成为首个部署Vera CPU的客户。与以往通常将CPU作为整体超级芯片(Superchip)或机架系统一部分的销售策略不同,英伟达此次明确将提供Vera CPU作为基础设施的“独立部分”。

这意味着客户在构建计算堆栈时将拥有更大的灵活性,而无需被迫购买整个机架级解决方案。黄仁勋暗示,虽然尚未正式宣布其他CPU设计的中标情况,但后续将会有更多客户加入。

Vera架构解析:代号“Olympus”的性能跃升

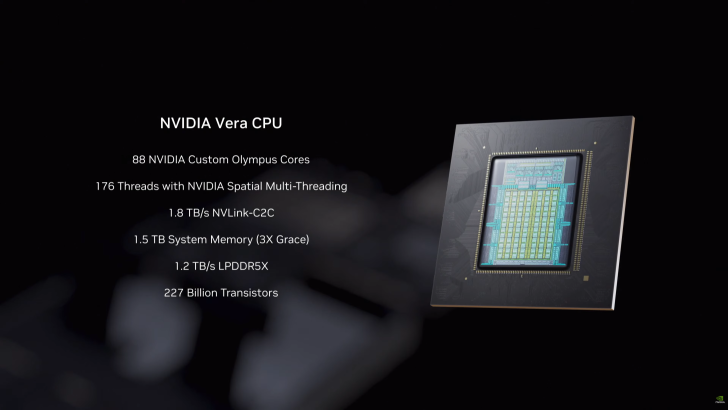

从技术规格来看,Vera CPU代表了英伟达在处理器设计上的巨大飞跃。该处理器基于下一代定制Arm架构,代号为“Olympus”,旨在处理最苛刻的AI和计算工作负载。

数据显示,Vera CPU配备了88个核心和176个线程,并引入了英伟达所谓的“空间多线程”(Spatial Multi-Threading)技术。

在内存性能方面,Vera配备了1.5 TB的系统内存,是上一代Grace CPU的三倍;同时采用SOCAMM LPDDR5X技术,实现了1.2 TB/s的内存带宽。此外,通过NVLink-C2C互连技术,其相干内存互连速度高达1.8 TB/s,是Grace的两倍。

相比于Grace CPU,Vera在缓存设计上也进行了大幅升级。每个核心拥有2MB的L2缓存(是Grace的两倍),以及162MB的共享L3缓存(提升了42%)。

这使得Vera能够更快速地与配对的GPU共享数据,显著提升系统整体效率。英伟达方面表示,Vera将是其目前功能最强大的CPU产品之一,并在机架级机密计算方面具备领先优势。

值得注意的是,Vera CPU并非孤立存在,它是英伟达下一代Vera-Rubin平台的核心组件。

英伟达高性能计算和AI工厂解决方案高级总监Dion Harris透露,Vera-Rubin NVL72平台的核心芯片已从台积电返回,目前正在进行调试并发送给关键合作伙伴,预计将在2026年下半年开始量产。

该平台将Vera CPU与代号为“Rubin”的下一代GPU相结合。Rubin GPU预计将采用HBM4内存,带宽高达22 TB/s,是Blackwell GPU的2.75倍。

打破供应链瓶颈,应对市场需求

报道指出,英伟达大力推行独立CPU策略的背后,是对AI供应链瓶颈的深刻洞察。随着代理人工智能(Agentic AI)应用的加速普及,服务器CPU正逐渐成为制约系统整体性能的关键因素。

英伟达意识到,仅仅依靠GPU算力的增长已不足以满足市场需求,必须提供一个性能匹配的CPU平台。

分析指出,通过提供独立的Vera CPU,英伟达不仅能够为客户提供绕过传统x86架构瓶颈的“变通方案”,还能通过更低成本的选项吸引那些希望获得高端CPU能力但预算有限的客户。

除了CoreWeave,英伟达Vera-Rubin系统的早期客户名单还包括亚马逊AWS、谷歌Cloud、微软Azure、甲骨文Cloud Infrastructure等云巨头,以及Lambda、Nebius和Nscale等新兴玩家。

分析指出,尽管部分云服务商正在自研加速器,但英伟达正通过在服务器CPU生态系统中“下重注”,试图在下一代AI基础设施竞争中保持其不可撼动的核心地位。

赞

赞

.png) 186

186

收藏

收藏

(1).png)